这个迫在眉睫的人类立场也是一个有趣的例子。它不仅可以证明AI取代了人工智能,而且还可以验证有时技术实施的目的不是使大多数人受益,而是“降低成本并提高效率”。

企业和用户通过产品进行交易。发生冲突时,客户服务是企业与用户之间的通信桥梁。但是,除了薪水外,该公司还必须承担培训,场地等的费用,并且员工还需要下班和休息。如果他们进行三个班次以提供24小时的客户服务,那么成本就是飙升。因此,在过去的十年中,许多公司采用了未成熟的AI技术,使用户可以感觉到“人工智能迟缓”是什么。

作者还对此有深刻的了解。有时,AI客户服务可以解决问题,但是当您急忙时,手机另一侧的AI仍在慢慢地报告项目,以供您拨打。最后,我发现没有相应的功能。该选项会使人们刺激。

从技术角度来看,早期智能客户服务将NLP(自然语言处理)技术作为核心,集成了ASR,TTS,机器学习,知识图和其他技术,以使机器能够完成识别,理解和反馈。从本质上讲,它仍然是判别的AI。仅凭这一点,它的效果就不能很好,因为歧视性的AI不好。

该公司非常了解这一点,但是太便宜了!

幸运的是,故事仍然有下半场。随着以大型模型技术为代表的生成AI的兴起,新一代的智能客户服务已变得“可说的”,这大大改善了用户体验并击倒了手动客户服务的最后一棺材。指甲。

在中国,智能客户服务是“热点”。智能客户服务已在金融,政府,电信,互联网/电子商务,零售,能源,制造,医疗服务等领域广泛使用。去年8月,国际数据公司(IDC)发布了“中国智能客户服务市场份额,2023年:新旧的交替,预计增长。”该报告表明,2023年智能客户服务解决方案的总体市场规模达到30.8亿元人民币,比2022年增加了近36.9%。

去年年底,作者采访了Ronglianyun副总裁Kong Miao。在智能客户服务领域拥有丰富经验的Kong Miao认为,通过智能客户服务代替智能客户服务是一个显然的“技术驱动器”,其中Internet,Mobile和the First First。一些公司从数据和大型模型等技术中受益,然后促进相应的产品和软件标准。

先进的生产力肯定会替代向后的生产力,这也可以从其发起人那里看到。在国内智能客户服务领域,市场份额的前三名是云制造商。他们拥有庞大的客户群和大型模型的国内研发和开发的主要力量。在更大的全球市场中也是如此。不久前,亚马逊连接,由Amazon Cloud Technology在2024年RE:Invent Global会议上推出的云联系中心解决方案,具有强大的智能客户服务能力,据说使Midea Global Contern Center的用户电话访问率提高到60秒内超过95%。

将来,人类将不得不习惯与人工智能打交道,但他们仍然“认识人们,但不认识他们的心”。我们如何判断AI的善与恶?

03。谁会决定AI的善与恶?

这个问题实际上应分为两个部分。首先,人类希望很好地“教” AI。

当AI本身培训的数据偏离时,算法本身会出现问题,并且当训练AI目前尚未进行指导原则时,AI可能“学习不好”。有一个训练大型语言模型的原则:“输入垃圾,输出垃圾”。最近,纽约大学自然医学大学研究人员发表的一项研究表明,只有0.001%的培训令牌被错误信息取代,培训的可能性更大。传播错误药物的模型。至于容易产生幻觉的,还有一个“喜欢欺骗人们”的大语言模型,它的陈词滥调越大,模型越大,更难纠正。

以智能客户服务为例,Kong Miao介绍了他们实施该模型时,为了使模型能够更好地了解行业条款,业务流程和客户需求,他们将使用企业累积的数据资源,并在此期间垂直垂直训练阶段。该领域的公共数据以增强对模型的理解。应用时,我们还应注意流程效率,数据集成等,包括公共和私人数据的集成以及实施诸如抹布之类的支持措施。

此外,我们还必须提防坏人使用的大型模型,例如Microsoft的Chat AI,该聊天AI曾经由网民教授来发誓,不得不脱机。在大型模型时代,一旦使用智能AI造成的伤害将变得更加严重。

但是,人类AI的应用水平也在不断改善,这些问题将逐渐解决。

更大的问题是,当人类有能力训练好模型时,他们故意“教” AI是为了利益的目的,就像本文开头一样。归根结底,AI的良心取决于训练它的人。

不久前,一项IBM研究发现,AI已经可以非常擅长编写网络钓鱼电子邮件,可以自动产生和执行大量分布。随着人工智能变得更聪明,谎言变得越来越完美,人类将从诅咒变成半束缚和半个怀疑,然后再到不信。现在,中国互联网显示出被AI产生的内容污染的迹象。去年,有人用chatgpt写虚假新闻,说杭州会举起汽车限制,许多媒体重印了。

确保安全使用大型模型也是人类将来面临的重要挑战。

2023年4月,Openai发行了白皮书“我们朝着人工智能的安全道路迈进”,该纸上提到了6个原则:

但是直到去年5月,Openai才正式建立了安全理事会,并于8月开始将新模式移交给美国政府进行安全评估。

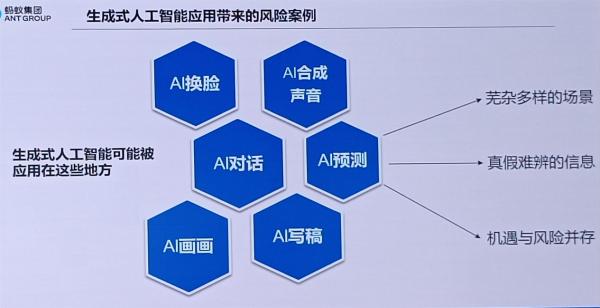

去年年底,蚂蚁集团数据治理与发展部主任吴Yingjing在接受HINDWS的采访中谈到了这个话题。他说,AI发展的最终主张是我们是否将成为“矩阵”并由AI控制。一切?目前,AI基本上仍锁定在笼子中。

“首先,政府对AI的态度非常明确。在2024年6月的欧盟的“人工智能法”中,提出了对人工智能进行评分的概念。欧洲一直是人权上的第一个,但适当而灵活的人工智能,将人工智能的风险分类,例如保险拒绝过程,甚至在将来的犯罪发现过程中,使用AI都必须进行更强大的手动干预,以确保它没有偏见和歧视每天都在询问如何购买门票以及如何订购餐点。

从“个人信息保护法”的角度来看,我国有关于自动决策的明确声明。首先,如果自动决策对个人权利和利益产生重大影响,则必须能够给出完整的解释并能够向用户解释;其次,用户必须有权拒绝自动决策,需要手动判断。至少我已经了解到,无论是财务还是其他领域,涉及对用户产生重大影响的链接,它必须基于可解释的规则并依靠在中国进行体力劳动的强大干预。透明

本文采摘于网络,不代表本站立场,转载联系作者并注明出处:http://mjgaz.cn/fenxiang/274077.html