引领大语言模型浪潮的 Ilya Sutskever 在 AI 顶级学术会议 NeurlPS 年会上当着全球数千名 AI 研究人员的面宣布:预训练已死。

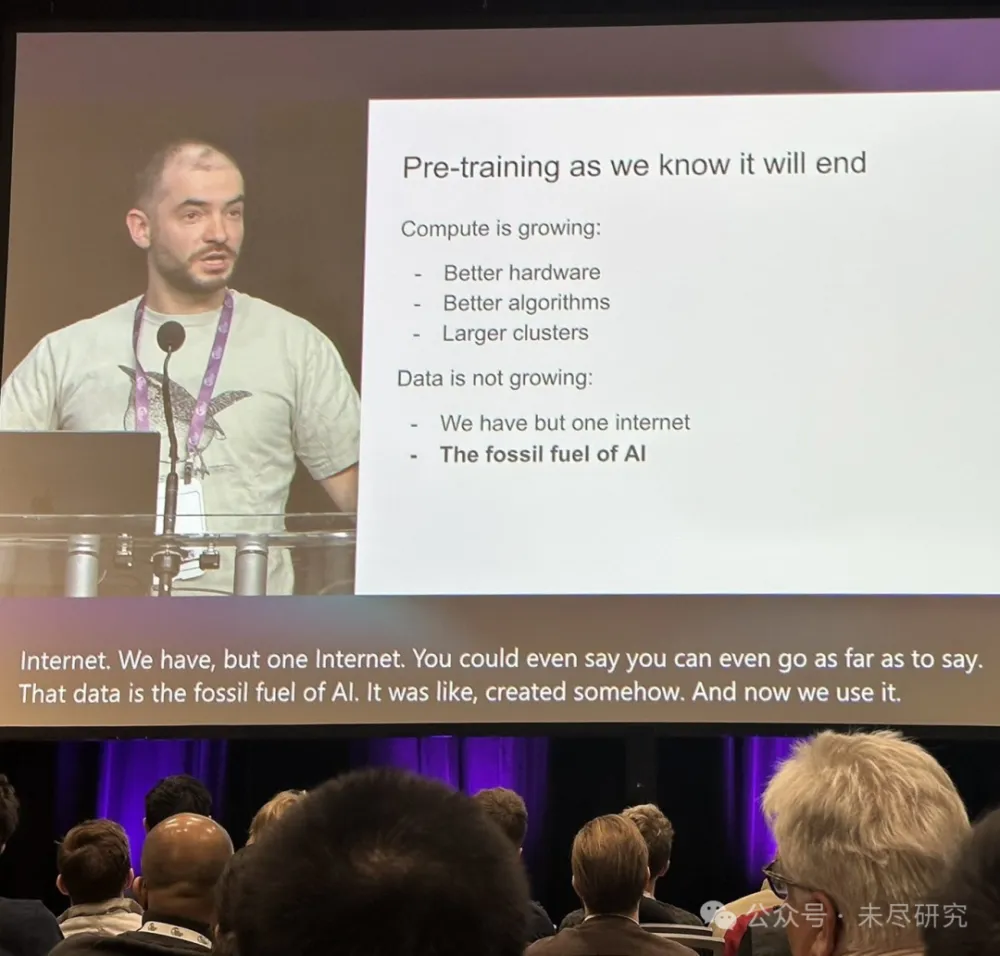

“但我们所知道的预训练毫无疑问将会结束。虽然计算在增长,但数据却没有增长,因为我们只有一个互联网。”数据没有增长,因为我们只有一个互联网。)。

从2012年的AlexNet到2022年的ChatGPT,Ilea是深度学习黄金十年最重要的先驱者之一。

他是OpenAI的技术灵魂。他坚持用语言数据训练AI,相信缩放定律,用大算力驱动大型语言模型(LLM)。从拥有1亿个参数的GPT-1到18000个拥有1亿个参数的GPT-4,OpenAI引发了一场生成式AI革命。

正当人们以为大语言模型会沿着预先训练的轨迹继续扩展,再过两个数量级,其参数将达到人脑突触的数量时,这个过程可能会戛然而止。

然而,人工智能将选择一条不同的前进道路。

Ilea指出了数据的三个来源:人工智能可以生成新数据,人工智能本身可以从大量可能的答案中决定哪一个是最好的,人类可以从现实世界获取数据。而且,真正的逻辑推理能力所使用的数据往往是有限的。

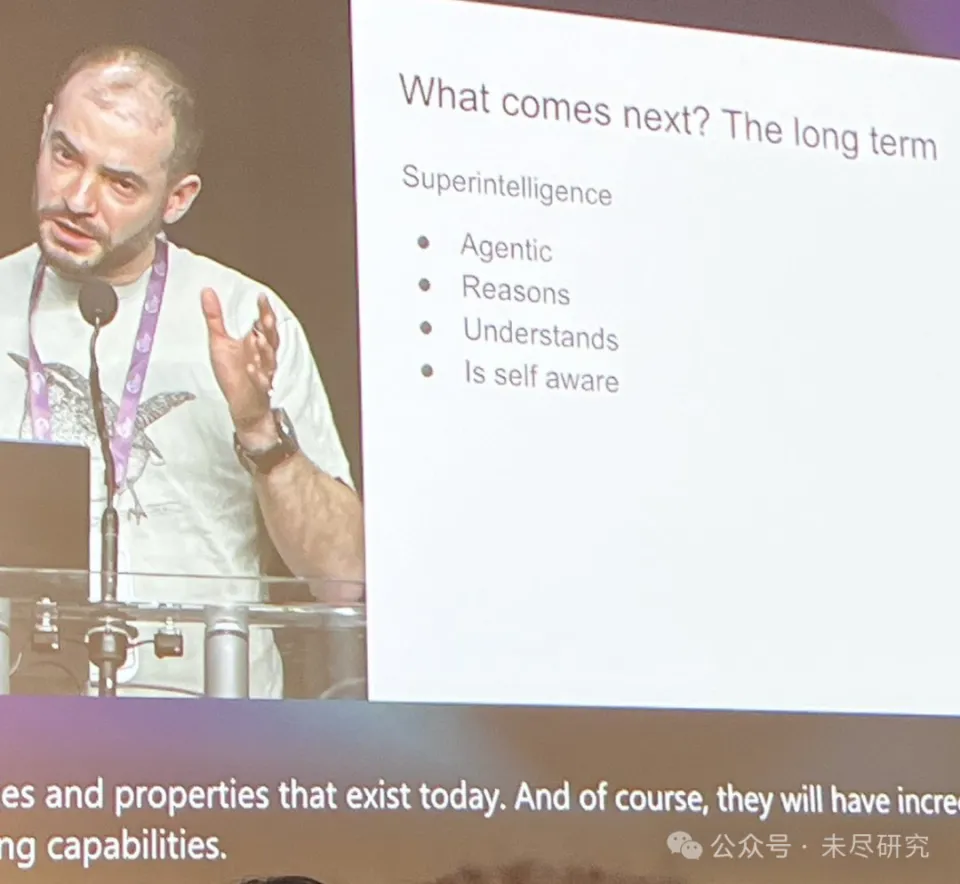

伊莱娅发布了新的预测,我们将走向超级智能,这将与之前的智能有质的不同。 “人工智能系统的本质和特征即将发生根本性的变化。”

就像人的大脑一样,它不会变大,而是不断进化。基于大型模型的代理和工具将推动和加速人工智能的发展。

伊莱娅简单介绍了什么是超级智能。 AI Agent(智能代理或代理)将像人类一样,仅依靠有限的数据来深入思考问题,更深入地理解工作逻辑,并产生自我意识。 “我不知道它什么时候会来,也不知道它会如何来,但它会来。”

一年前在OpenAI董事会发动政变后,他退休了半年,一走了之,并宣布成立一家新公司:Safe Superintelligence Inc.。

对于超级智能的推理能力,“推理越多,就越不可预测。 (推理越多,就越不可预测。)我们当前的人工智能是可测量的,因为它基于人类直觉。 “如果要求人脑在0.1秒内给出答案,它只能凭直觉做出反应。”

因此(机器的)推理将是不可预测的。就像2016年AlphaGo第二轮对阵李世石时打出的“神棋”一样,“人工智能只有变得不可预测,才能击败人类”。

超级智能将变得有自我意识。 “为什么不呢?自我意识是有用的,就像我们人类一样,意识是自我的一部分,自我意识是我们世界模型的一部分。”

“我们将面对一个完全深不可测的情报。预测是不可能的,因为一切皆有可能。”伊莱亚结束了他的正式演讲,一位听众指出演讲充满了神秘色彩。

接下来是充满智慧的问答。现场有人问,既然你认为超级人工智能有一天会超越智人,那么你会建立什么样的激励机制,让我们智人放弃所有的自由,迈出决定性的一步? ?

伊莱娅先是长长地吸了一口气,沉思了片刻……

“这确实是人们需要更多思考的问题。我没有足够的信心回答这个问题。这有点像设计一个自上而下的结构,就像政府一样。”

“会不会是加密货币?”

“我认为我不适合谈论加密货币,但是……(嘀咕了很多)人工智能可能会像我们人类一样产生权利,这需要被定义……但我不想更多地谈论它,因为事情是事情变得如此不可预测,你可以猜到。”

以下是Elia演讲及问答的完整视频。

本文采摘于网络,不代表本站立场,转载联系作者并注明出处:http://mjgaz.cn/fenxiang/273263.html